Kontoret er ikke

direkte kjedelig, men cella innenfor glassdøra på NTNU avslører ikke akkurat at

dette er basen til en av landets mest kjente forskere heller.

For Inga Strümke er blitt en slags guru for folk som er interessert i kunstig intelligens i Norge, litt på grunn av boka Maskiner som tenker. Litt mer fordi hun liker å dele det hun kan med resten av oss.

Nå skal EU innføre nye og strengere regler for bruken av kunstig intelligens. Den såkalte AI Act. Som EØS-medlem henger Norge seg antakelig på med nøyaktig de samme reglene.

– Jeg er ingen tilhenger av regulering for reguleringens skyld, sier Strümke.

Men hun ser flere grunner til at Norge skal være med på akkurat dette.

– Norge er en del av Europa og verden. Det er politisk viktig at vi fortsatt samarbeider tett med EU om disse spørsmålene.

Men utover det rent politiske er AI Act viktig for deg og meg også.

– Vi skal ikke ha AI som utnytter folks svakheter, sier hun.

Bruk av AI som kan være farlig eller urettferdig, får mye strengere regler enn bruk som tilsynelatende er mer uskyldig. Noen bruksområder blir rett og slett forbudt i EØS og EU.

– Reglene skal beskytte oss forbrukere. De skal bidra til at vi er trygge og kan ha tillit til bruken av AI, oppsummerer hun.

Dette er EUs AI Act

AI-loven deler AI-bruksområder i forskjellige risikokategorier:

- Uakseptabel risiko: Denne bruken blir forbudt i EU. Dette inkluderer AI som manipulerer menneskelig atferd, biometrisk fjernidentifikasjon i sanntid, for eksempel ansiktsgjenkjenning i offentlige rom eller bidrar til å gi folk en slags oppførselskarakter som kan gi dem fordeler eller ulemper i samfunnet.

- Høyrisiko: Dette er AI-systemer som truer helse, sikkerhet eller grunnleggende rettigheter, for eksempel de som brukes innen helsevesenet, utdanning, rekruttering, styring av kritisk infrastruktur, håndhevelse av lover og regler eller rettsvesenet. Disse får svært strenge regler.

- General-purpose AI (GPAI): Dette inkluderer programmer som Chat GPT. Disse må oppfylle visse krav til åpenhet. De må evalueres grundig.

- Begrenset risiko: AI-systemer som er underlagt krav til åpenhet, inkludert de som frembringer eller manipulerer bilder, lyd eller videoer. Kildekode-modeller som er gratis og åpne med offentlig tilgjengelige parametere, er generelt ikke regulert.

- Minimal risiko: Inkluderer for eksempel stavekontroller og AI-systemer for videospill eller spamfiltre. Ikke regulert på EU-nivå.

Informasjonen i denne faktaboksen er hentet fra engelsk Wikipedia. Deretter ble den forkortet av Chat GPT, før den ble oversatt av Google Translate. Til sist er den gjennomgått av mennesker.

Hva om vi ikke får regler?

Men. Er det nå så farlig om vi ikke får sånne regler, da? Alle vet jo at regler ofte er irriterende.

– Vi kan jo gi blaffen i trafikkreglene også, sier Strümke. Da kan alle kjøre mye fortere.

En kort stund. Til det smeller.

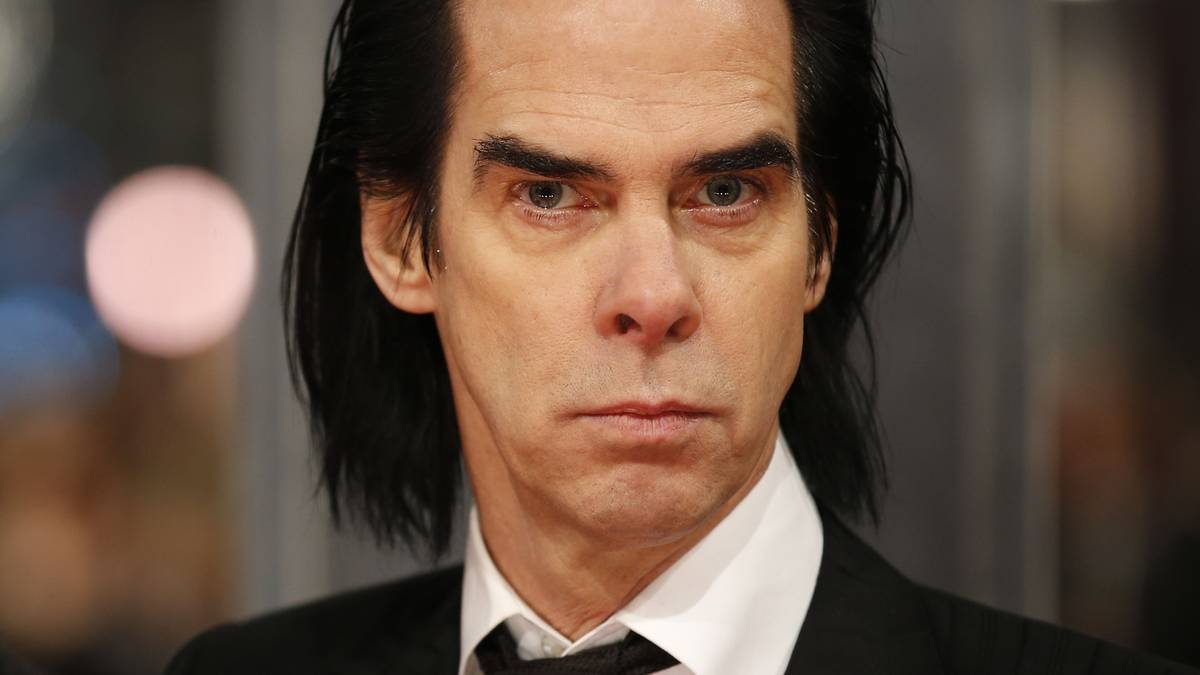

Reglene skal beskytte oss forbrukere. De skal bidra til at vi er trygge og kan ha tillit til bruken av AI, sier Inga Strümke. (Foto: Mona Hauglid)

– AI er en så sterk kommersiell kraft. Da ChatGPT åpnet, tok det fem dager før de hadde en million brukere, sier hun.

ChatGPT er i hvert fall foreløpig den mest berømte chatboten. Elever og studenter i hopetall har allerede tatt snarveier ved å bruke den.

– Vi er ennå ikke ferdige med å håndtere bruken av AI i utdanningssektoren, sier hun.

For når du lar AI gjøre nesten alt arbeidet, er det neppe stort du lærer heller.

Flere har regler

Nå heter det visst KI på norsk, for kunstig intelligens. På norsk får da EU-reglene også navnet KI-forordningen. Men Strümke bruker mer eller mindre konsekvent den internasjonale betegnelsen AI for «artificial intelligence».

Men. Det er jo ikke sånn at resten av verden nødvendigvis vil forholde seg til de samme, strenge reglene som EU og Norge. Hva skal hindre for eksempel Kina eller USA i å ha et slappere regelverk og dermed kanskje gi dem en konkurransefordel?

– Ingenting. Vi kan ikke hindre andre land i å ha andre regler. Men det er en myte at bare EU regulerer bruken av kunstig intelligens.

Tidligere i år hadde USA allerede 58 ulike regelverk for bruk av kunstig intelligens, rett nok fordelt på flere ulike delstater. Men det er altså ikke fritt frem andre steder heller.

– Vi må velge hvilket samfunn vi ønsker å ha. EU har hatt en tendens til å sette en presedens for andre, sier hun.

EU går ofte foran

Der EU går, følger nemlig andre deler av verden gjerne etter. Strümke illustrerer det ved å vise frem en USB-C-kabel, den nye standarden for ladekabler i store deler av verden. Den ble nylig innført tross mye skrål og skrik fra teknologiselskaper i starten.

Men snart kan du altså slippe å ha hauger av forskjellige ladekabler liggende. Det skal holde med én type. Som ekstra fordeler overfører USB-C både mest data og strøm i tillegg til at ledningen kan brukes begge veier. At USB-C er standard, kan du altså takke EU for.

På samme måte har store deler av verden fulgt etter EUs personvernforordning, GDPR. Den skal gi deg større makt og rett til å kontrollere hva slags opplysninger selskaper kan samle inn om deg.

Hun tror det kan gå den veien med regler for kunstig intelligens også.

Maskiner som tenker

Inga Strümke er egentlig fysiker med doktorgrad innenfor partikkelfysikk, men de siste årene har hun konsentrert seg om kunstig intelligens.

Spesialiteten er maskinlæring, altså hvordan du trener opp den kunstige intelligensen og forklarbar kunstig intelligens. Det siste området tar for seg hva den kunstige intelligensen egentlig har skjønt og hvor denne kunnskapen kommer fra.

Hun har bestemt seg for å prioritere folkeopplysning, samtidig som hun ennå bruker mye tid på forskningen.

Allerede i vår passerte boka hennes Maskiner som tenker ett år på Bokhandlerforeningens bestselgerliste.

– Jeg så det å skrive bok som en mulighet for å få ordentlig oversikt over området kunstig intelligens, sier hun.

Ingen Terminator, men ...

Inga Strümke er ikke bekymret for at drapsroboter med kunstig intelligens skal ta over verden med det aller første. Men de enorme, raske fremskrittene innen AI byr likevel på problemer.

Allerede i vår passerte boka hennes Maskiner som tenker ett år på Bokhandlerforeningens bestselgerliste.

For hun er redd for at vi skal miste gnisten.

– Tidligere kunne vi også dumpe ned foran tv-en og la oss underholde. Men det var ikke det samme som nå. Nå kan vi bli sittende hele dagen.

For ulike underholdningstjenester og sosiale medier lærer ganske raskt hva vi liker og fôrer oss med nettopp det. Plutselig har du sittet mye lenger med TikTok eller YouTube enn du hadde tenkt.

– Dette er verre enn tvang. Disse tjenestene kommer med så gode anbefalinger. De kjenner deg så godt at du rett og slett ikke greier å stå imot, sier Strümke.

Dette kan tjenestene gjøre fordi de samler inn opplysninger om deg. Nesten alle av oss har trykket på knappene som tillater dem å gjøre det også, og da blir det lovlig.

Med de nye EU-reglene kan denne datainnsamlingen bli mer vrien, i hvert fall det å bruke opplysningene til å hekte oss foran skjermen i timevis.

Selv bruker Strümke knapt nok sosiale medier lenger. Vel, unntatt Instagram.

Men AI truer ikke bare fritida vår. Den truer også demokratiet.

Hvem får stemmen din?

Politiske valg blir også påvirket ved hjelp av kunstig intelligens. Den mest underholdende politikeren kan få mest oppmerksomhet.

Det er ikke nytt. Men desinformasjon blir spredd gjennom «deep fakes», bildemanipulering og målrettede falske nyheter.

Dette bildet er altså laget ved hjelp av kunstig intelligens. Utgangspunktet er det lille bildet av Inga Strümke under. Legg merke til at hånden har minst seks fingre, foreløpig en typisk feil når vi tar AI til hjelp. ( Illustrasjon: Kolbjørn Skarpnes / openart.ai)

Budskapene kan altså spesialtilpasses for den enkelte eller for grupper ved hjelp av kunstig intelligens og sosiale medier. Da ligger vi tynnere an.

Nå har jo løgn og fordeler for de attraktive alltid vært en del av politikken. Under presidentvalget i USA i 1960 tapte Richard Nixon for John F. Kennedy. Det hjalp i hvert fall ikke Nixons sak at han stilte på tv (YouTube) stotrende, klønete og uten sminke mot den sjarmerende rivalen.

Bildet som ble brukt som utgangspunkt for å lage den AI-genererte illustrasjonen ovenfor. (Foto: Mona Hauglid)

– Jeg er uenig med meg selv om det vi ser nå, er noe helt nytt. Men det er annerledes nå enn før. Nå trenger du ikke lenger et stort apparat med mange folk for å påvirke en valgkamp. Det du trenger, er nok datamaskiner, sier forskeren.

En typisk russisk propagandastrategi er for eksempel ikke nødvendigvis å lyve direkte hele tida. Isteden bombarderes folk med motstridende opplysninger til de går lei.

– Folk rammes av en «digital fatigue». De blir utslitte av det. Sånt kan også virke pasifiserende, sier Strümke.

Strategien åpner også for populister. Folk med enkle budskap som trenger gjennom kaoset, akkurat det budskapet du vil høre, gjerne tett i tett med et budskap om en eller annen minoritet som har skylda eller et annet, passende fiendebilde.

Så. Da går vel alt galt?

Bruken av kunstig intelligens byr altså på mange farer og feller. Verden er i endring, og langt fra alt ser ut til å være i god retning.

– Folk spør ofte om jeg er optimist eller pessimist. Det jeg kan si, er at jeg aldri er midt imellom. Dette kan gå til helvete. Og det kan gå skikkelig bra, sier Strümke.

På den ene siden har vi alle problemene i verden. Vi mennesker ødelegger planeten, utrydder arter, ødelegger arealer, kjøper mengder av greier vi ikke trenger som er fraktet langt borte fra, og over det hele lurer et klima som endrer seg. Vi har fått mindre demokrati og mer uro de siste årene.

Hver for oss er ikke vi mennesker dumme. Men systemene våre, organiseringen vår av samfunnene våre, de er ikke alltid så smarte. Av og til er kunstig intelligens en del av problemet.

Men på den andre siden har vi mulighetene. Og løsningene kan like gjerne få hjelp av kunstig intelligens om vi bruker den smart.

– Jeg kan ikke komme på et eneste område som ikke kan få bruk for AI, sier Inga Strümke.

Referanse:

Inga Strümke: Maskiner som tenker. Kagge forlag, 2023.

2 months ago

43

2 months ago

43

English (US)

English (US)